Nvidia Jetson Nano jest zestawem programistycznym, który składa się z SoM (System na module, z ang. System on module) i płyty głównej. Był on początkowo przeznaczony do tworzenia systemów wbudowanych, które potrzebują wysokiej mocy obliczeniowej w aplikacjach uczenia maszynowego, z systemem wizyjnym, i przetwarzających obraz. Nvidia nie jest “zielona” na rynku systemów wbudowanych (embedded computing). Firma wypuściła już wcześniej inne płytki do uczenia maszynowego – Jetson TK1, TX1, TX2 oraz giganta na rynku, Jetson AGX Xavier.

Jetson Nano różni się od nich paroma rzeczami. Przede wszystkim ceną – kosztuje on tylko 99$. Jeśli chciałbyś dawniej kupić serię płytek Jetson, musiałbyś wydać przynajmniej 600$ na samo TX2. Ponadto Nvidia Jetson Nano jest bardzo prosty w obsłudze, ponieważ przygotowano dużo przewodników i instrukcji. Jest on doskonały dla początkujących, jak i dla tych z niewielkim pojęciem o uczeniu maszynowym i wbudowanych systemach.

Jeszcze w roku 2017 na płytce Jetson TX1, prawie niemożliwym było stworzenie czegoś znaczącego bez:

- pomocy inżyniera systemów wbudowanych

- spędzania godzin na stronie Stack Overflow i forach NVIDIA, próbując rozwiązać problem.

Oznacza to, że Nvidia dąży do masowego wprowadzania sztucznej inteligencji, tak jak zrobiło to Raspberry Pi z systemem wbudowanym.

Zobacz czym jest Raspberry PI!

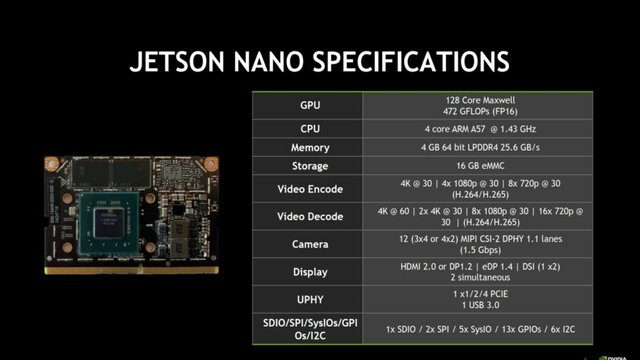

System posiada 128 rdzeni CUDA procesora graficznego Maxwell i czterordzeniowy procesor ARM A57 działający z częstotliwością 1,43 GHz oraz wbudowane 4GB pamięci LPDDR4. Nie dość, że procesor ARM A57 jest całkiem szybki, a 4GB pamięci to bardzo dużo jak na płytkę wartą 99$, to podstawą uczenia maszynowego jest jej procesor graficzny. Procesory te są bardziej odpowiednie do ćwiczeń i inferencji, dlatego, że posiadają architekturę wysokiego paralelizmu i wysoką przepustowość pamięci (HBM). Jeśli wyżej wspomniane wyrażenie “128 rdzeni CUDA procesora graficznego Maxwell” nic Ci nie mówi, zacznij myśleć o rdzeniach CUDA w ten sam sposób jak o rdzeniach normalnego procesora – pozwalają one wykonywać więcej działań jednocześnie.

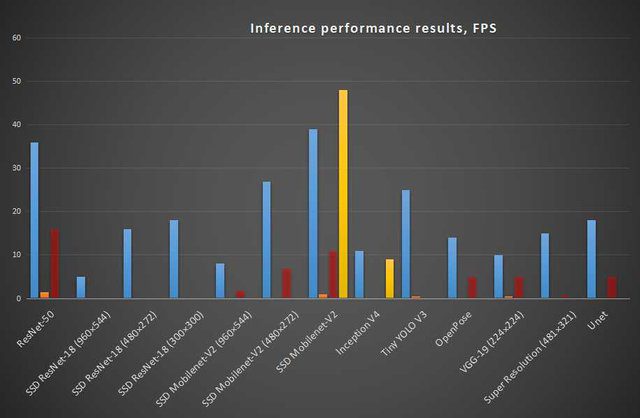

Nvidia twierdzi, że procesor graficzny Jetson Nano ma 472 GFLOPS (Giga Operacji Zmiennoprzecinkowych na Sekundę, z ang. Giga Floating Point Operations per Second) mocy przetwarzania danych. Jest to interesująca liczba, ale niestety, jest ona bardziej użyteczna w porównywaniu Nano z innymi produktami Nvidia, a nie w porównywaniu Nano z produktami innych firm. A jest tak, ponieważ określanie rzeczywistej prędkości inferencji zależy też od kilku innych czynników. Lepszym testem wydajności mogłoby być ich bezpośrednie zestawienie podczas uruchamiania modeli uczenia maszynowego. Oto porównanie ze strony NVIDIA:

Niebieski słupek – Nvidia Jetson Nano

Pomarańczowy słupek – Raspberry Pi Model 3

Czerwony słupek – Raspberry Pi 3 + Intel Neural Compute Stick 2

Żółty słupek – Google Edge TPU Coral

Jak widzimy, Jetson Nano ma wyraźną przewagę nad Raspberry Pi 3 + Intel Neural Compute Stick 2. Uwzględniając porównanie z płytkami Coral, jest za wcześnie by stwierdzić, że wiele testów jest jeszcze niedostępnych.

Zestaw Jetson Nano jest odzewem Nvidia na “wbudowaną platformę AI dla wszystkich”. Ma on wszystkie cechy i cenę zapewniające sukces. Czas pokaże jak sprawdzi się na tle swoich konkurentów.

Przegląd sprzętu

Trzeba podkreślić kilka rzeczy:

- Pomimo tego, że zestaw nie posiada wiatraczka, radzimy takowy kupić, ponieważ płytka znacząco się nagrzewa, szczególnie podczas ładowania.

- Brakuje obsługi kluczu sprzętowego WiFi. Przetestowaliśmy trzy różne i dwa z nich nie miało sterowników dla architektury Jetson Nano.

- Oficjalnie, adaptery HDMI-VGA nie są obsługiwane, ale niektóre modele działają z Jetson Nano. Nie ma listy adapterów pracujących z tym zestawem, więc zalecane jest mieć ekran, który posiada wejście HDMI.

- Istnieją 4 sposoby zasilania płytek, przez: Micro USB (5V, 2A), wtyk zasilający DC 5,5 / 2,1 mm (5V, 4A), GPIO i PoE (Zasilanie przez Ethernet). Na płytce znajdują się zworki do przełączania trybów zasilania – z domyślnego poprzez Micro USB, na wtyk zasilający lub PoE.

Recenzja oprogramowania

Tutaj znajdziesz film z przygotowania pierwszego uruchomienia systemu i wersji demo.

Zaskakująco trudno było znaleźć i uruchomić wersje demo, z którymi sprzedawany jest domyślny obraz. Grupa docelowa Jetson Nano, to początkujący i średnio zaawansowani użytkownicy Linuxa. Dlatego, powinno się go łatwiej uruchamiać i (jeśli to możliwe) oprzeć na innych demach produkowanych z obrazem.

Dema możesz znaleźć tutaj:

Próbki CUDA w usr/local/cuda-10.0/samples: Symulacja dymu, cząsteczek, itd.

Skopiuj to do swojego folderu domowego. Następnie, przejdź do katalogu przykładu, który chcesz uruchomić i wykonaj go poleceniem – make. Później uruchom /.nazwa pliku wykonywalnego.

Przykłady Visionworks usr/share/visionworks/sources/demos: Przetwarzanie video, oszacowanie ruchu, konstrukcja przedmiotu, itd.

Skopiuj to do swojego folderu domowego, a następnie przejdź do katalogu dem i uruchom poleceniem – make. Pliki wykonywalne zostaną razem skompilowane i umieszczone w ~sources/bin/aarch64/linux/releases.

Są również dema TensorRT, które są skoncentrowane na uczeniu maszynowym. Nie ma ich w filmie, ponieważ większość z nich realizowana jest w wierszu poleceń.

Płytka Nvidia Jetson Nano będzie dostępna w sprzedaży w naszym sklepie na przełomie maja i czerwca tego roku.

Źródło: https://www.seeedstudio.com/blog/2019/04/03/nvidia-jetson-nano-developer-kit-detailed-review/

Jak oceniasz ten wpis blogowy?

Kliknij gwiazdkę, aby go ocenić!

Średnia ocena: 5 / 5. Liczba głosów: 1

Jak dotąd brak głosów! Bądź pierwszą osobą, która oceni ten wpis.

Jedna odpowiedź

Czy da sie na tym zainstalowac zwyklego linuxa? a nie w wersji arm hf?

Chodzi mi o zwyklego linuxa x86 lub x64.